Open AI의 ChatGPT를 처음 경험한 이용자들은 사람처럼 맥락을 이해하며 대화하는 인공지능에 적지않은 충격을 받았습니다. ChatGPT는 생성형 AI(Artificial Intelligence)로써 대화뿐만 아니라 이용자가 요청한 소설 및 영화의 시나리오를 작성해준다거나 파이썬과 같은 프로그래밍 언어로 코드를 작성해주는 등의 기존 챗봇과 비교가 안되는 비약적인 성능 향상을 보여주면서 ChatGPT는 출시된지 5일만에 이용자 수 100만명, 두 달만에 이용자 수가 1억명으로 증가하였습니다.[1]

ChatGPT 이후 생성형 AI는 더욱 발전하여 단순히 글로 명령을 내리는 것만으로도 그림, 음악, 영상 등을 손쉽게 생성하거나 합성, 편집을 할 수 있게 되었습니다. 여러 산업에도 인공지능 활용하여 고객 개인형 맞춤 서비스를 제공하거나 제조 공장의 생산성을 높이는 등의 사례가 점차 증가하면서 우리 삶의 일부분이 되어가고 있습니다[2]. 그러나 사람들은 칼을 식재료를 손질하는 용도로 사용할 수 있지만 사람을 헤치는 흉기로써 사용될 수 있듯이 인공지능을 나만의 작곡가, 프로그래밍 보조 등으로 활용할 수 있지만 범죄에 악용할 수 있습니다. 특히 기존 영상에 원하는 사람의 얼굴을 합성하는 딥페이크(Deep Fake)를 이용한 성범죄가 이슈되어 또한 사람의 얼굴만이 아닌 목소리를 합성하는 딥보이스(Deep Voice)를 악용한 보이스피싱 사례도 발생하고 있습니다[3]. 인공지능 기술이 이대로 어떤한 제한없이 발전한다면 정교하고 치명적인 범죄도구가 될 수 있습니다.

국내에서도 인공지능 규제 법안들이 2020년부터 발의되어왔고 미국은 행정명령을 통해 AI 정책 8원칙을 세워 인공지능을 선의의 목적으로 활용하고 위험을 완화하도록 하고 있습니다. EU(Europe Union)는 세계 최초로 인공지능을 포괄적으로 규제하는 인공지능법(AI Act)을 2024년 5월 21일 최종 합의하였고 같은 해 8월 1일부터 발효되었습니다[4].

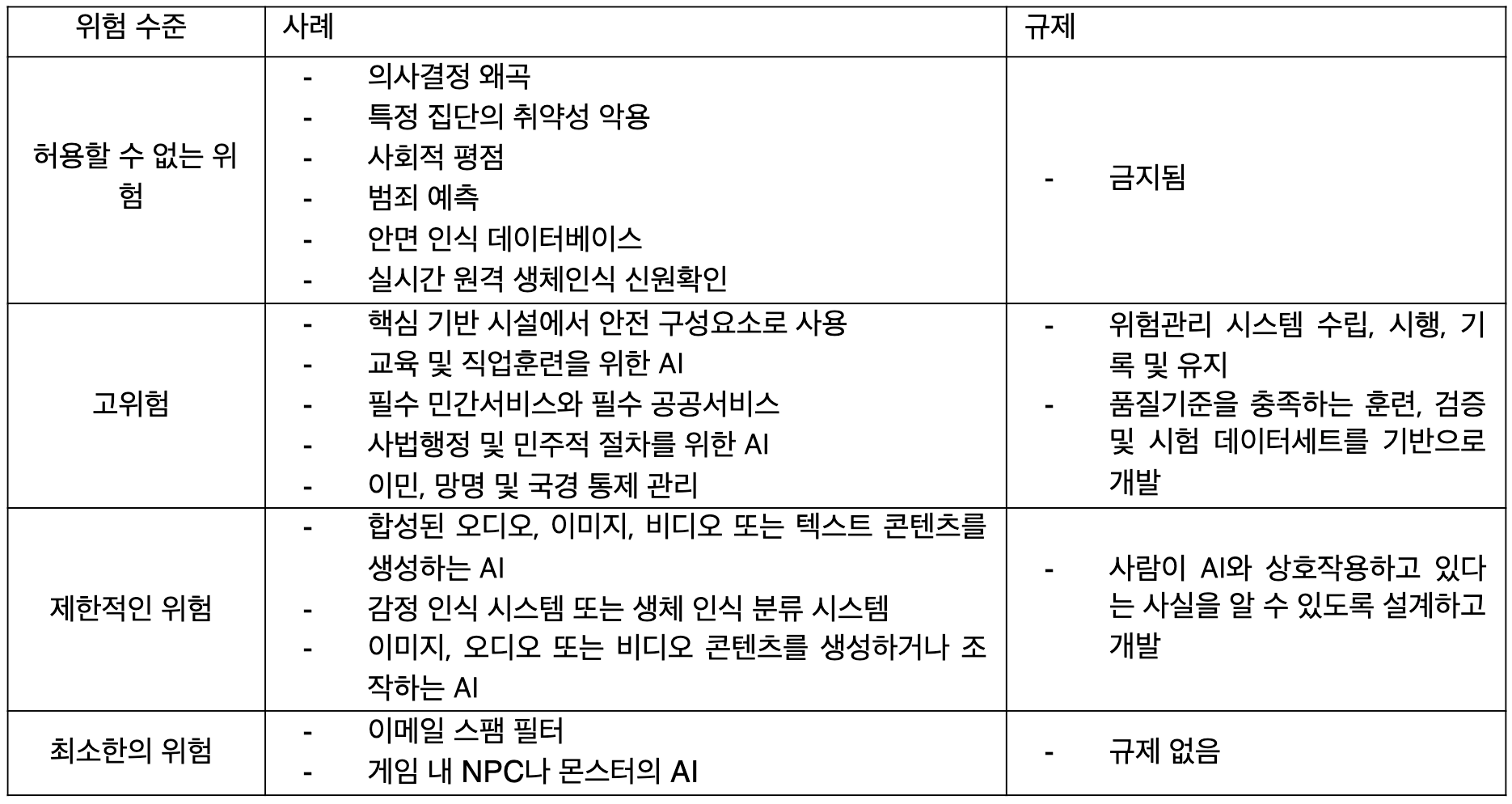

EU 인공지능법은 인공지능이 가진 위험 수준을 4가지(허용할 수 없는 위험, 고위험, 제한적인 위험, 최소한의 위험)로 분류하여 규제하고 있습니다. 허용할 수 없는 위험을 가진 인공지능은 금지하고 고위험 인공지능은 까다로운 요구사항 및 의무를 준수하도록 하고 있습니다. 제한적인 위험을 가진 특정 유형의 인공지능은 사람이 인공지능과 상호작용할 경우 이를 명확하게 알 수 있도록 투명성 의무를 부여하고 있습니다. 최소한의 위험 또는 위험이 없는 인공지능의 경우에는 사람의 기본권을 침해하지 않는 이상 규제가 적용되지않고 자유롭게 개발하거나 배포할 수 있습니다.

고위험 인공지능은 사이버보안을 달성해야 하는 요구사항이 적용됩니다. 인공지능은 다양한 사이버보안 위협에 대해 방지, 탐지, 대응, 해결 및 통제하는 조치를 요구하고 있습니다. 인공지능에 대한 사이버보안 위협에는 학습 데이터를 조작하는 데이터 오염 공격과 인공지능 학습 모델 자체를 변조하는 모델 공격, 그리고 모델이 실수하도록 설계된 값을 입력하는 적대적 예제 공격 등이 있습니다.

차량분야의 대표적인 인공지능 활용 사례인 자율주행차량은 EU 인공지능법에 따라 고위험 인공지능으로 분류됩니다. 그러나 고위험 인공지능이 지켜야하는 요구사항과 의무는 적용되지 않습니다. 그 이유는 EU 인공지능법의 제2조 적용 범위의 제2항에 따라 특정 유럽 조화법률에 영향을 받는 고위험 인공지능은 제112조 평가 및 심사만 적용되어 까다로운 요구사항과 의무는 부과되지 않습니다. 차량은 인공지능법에서 명시한 특정 유럽 조화법률인 TAFR(Type Approval Framework Regulation)과 GSR(General Safety Regulation)에 영향을 받기 때문에 고위험 인공지능이지만 인공지능법의 요구사항과 의무가 적용되지 않습니다.

하지만 인공지능 기반 자율주행차량이 완전히 자유로운 것은 아닙니다. TAFR과 GSR은 새로운 차량이 출시되기 전에 지켜야하는 요구사항들을 담고 있는 법률입니다. 유럽 집행위원회는 두 법률을 인공지능법의 고위험 인공지능에 대한 요구사항을 고려하여 개정할 예정입니다[5]. 두 법률이 개정된다면 차량 제조사는 자율주행차량 고위험 인공지능에 대한 요구사항들을 준수하여 개발해야 합니다.

인공지능의 이점만을 최대한 활용할 수 있도록 악용의 위험을 최소화해야 한다는 것은 전 세계가 공감하고 있고 그에 따라 관련 규제 법안들이 나오고 있습니다. 세상을 바꾸는 혁신도 좋지만 그 과정에서 많은 피해가 발생하지 않도록 해야 합니다. EU 인공지능법 또한 규제만 하는 것이 아닌 혁신을 위한 샌드박스 제도와 같은 조항도 포함되어 있습니다. 진흥과 규제의 적절한 균형을 통해 인공지능을 활용한 안전하지만 혁신적인 서비스들이 많이 개발 및 출시되면 좋겠습니다.

[1] https://www.4th.kr/news/articleView.html?idxno=2033232

[2] https://www.samsungsds.com/kr/insights/ai_use_cases.html

[3] https://www.hankyung.com/article/2024082952291

[4] https://www.moleg.go.kr/boardDownload.es?bid=legnlpst&list_key=3813&seq=1